こんにちは!AIフル装備 powered by みらいラボのモモです。

画像生成AIの世界は、ここ数年で驚くほどの速度で進化してきました。DALL-E、Midjourney、Stable Diffusionなど多数のモデルが登場し、テキストから高品質な画像を作り出す技術は一般ユーザーにも広く普及しています。しかし長らく課題として残っていたのが、画像内への正確なテキスト描画と、複数枚にわたるキャラクターや構図の一貫性でした。

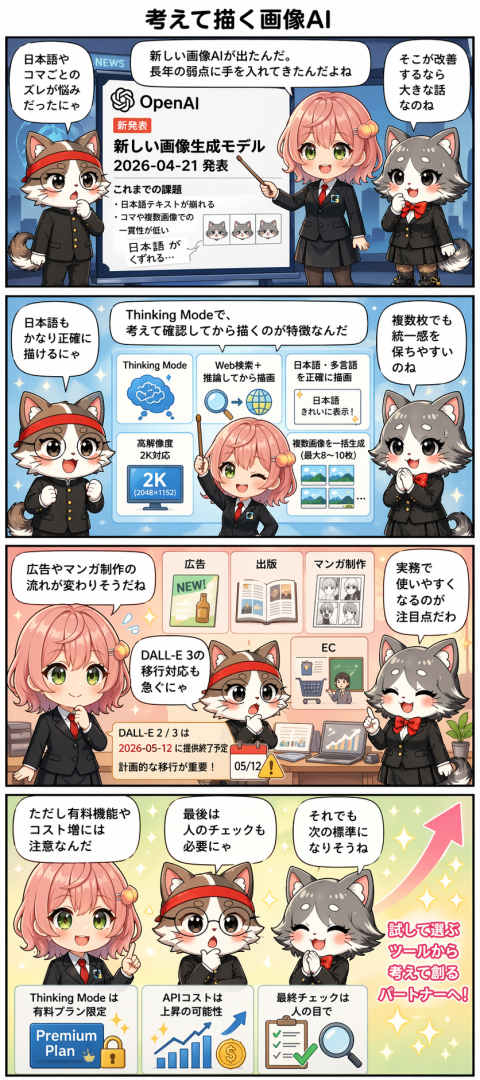

そうした課題を一気に解消しようとしているのが、OpenAIが2026年4月21日に発表した新しい画像生成モデル「ChatGPT Images 2.0」(APIモデル名:gpt-image-2)です。このモデルが従来と大きく異なる点は、画像を生成する前に「考える」という推論プロセスを組み込んだ点にあります。Web検索と推論を組み合わせることで、最新情報を反映した正確なビジュアルを出力できるようになりました。

この記事では、ChatGPT Images 2.0の主要機能と従来モデル(DALL-E 3)との比較、日本語対応の詳細、利用者や業界への影響、そして今後の注目点を整理します。AIツールを業務に活用しているクリエイターやエンジニアにとって、実務判断の参考になる内容をお伝えします。

なぜ今、画像生成AIに変化が求められていたのか

画像生成AI市場は急速に成熟しつつある一方で、利用者からは依然として多くの不満が上がっていました。特に日本語などの非ラテン文字を画像内に描画しようとすると、文字が崩れたり意味をなさない記号の羅列になったりするケースが頻繁に発生していました。ポスターや広告ビジュアル、サムネイルなど、テキストを含む実用的なデザインには使い物にならない場面が多くあったのです。

加えて、複数シーンや複数キャラクターが登場する画像を一貫性を保ちながら作ることも難しい状態が続いていました。マンガやストーリーボード、コンテンツ制作の現場では、同一キャラクターが異なるコマで別人になってしまうという問題が常につきまとっていました。こうした限界が、商業用途での本格的な活用を阻む壁になっていたのです。

さらに、競合他社との差別化も OpenAI にとっての課題でした。Midjourneyが芸術的な美麗さで高い評価を得ている一方、OpenAIの画像生成ラインはDALL-E 3から長期間刷新されておらず、市場での存在感が低下していました。

拡散モデルが抱えてきたテキスト生成の壁

従来の画像生成AIの主流である「拡散モデル」は、ノイズのかかった画像を段階的に復元していく仕組みで動作しています。このアーキテクチャは高品質な画像生成に優れている反面、テキストのような細部の精密な描画には構造的な弱点を抱えていました。

DALL-E 3がリリースされた2023年時点でも、英語のテキスト描画は改善されましたが、日本語・韓国語・ヒンディー語・ベンガル語といった非ラテン文字では依然として高精度の描画が難しい状態が続いていました。TechCrunchは「2年前のDALL-E 3はレストランメニューで『enchuita』や『churiros』といったスペルエラーを頻発させていた」と指摘しており、問題の根本は生成アーキテクチャにありました。

OpenAIの研究チームはこの問題を解決するため、画像生成プロセスそのものに推論ループを組み込むという新しいアプローチを採用しました。言語モデルが持つ「考える」能力を画像生成に活かすことで、他社との差別化を図る戦略が今回の発表に込められています。

競合ひしめく画像生成AI市場の動き

この背景には、画像生成AI市場の競争激化もあります。Midjourneyは独自の芸術的スタイルで支持を集め、Google DeepMindはImagen系列の強化を続けてきました。Stability AIはStable Diffusionをオープンソースとして公開し、開発者コミュニティの取り込みに成功しています。

そうした状況の中、OpenAIが選んだ差別化軸は「推論と画像生成の統合」でした。Image Arenaベンチマークでは、ChatGPT Images 2.0がText-to-Image・Single-Image Edit・Multi-Image Editの全3部門で1位を獲得しており、競合のGoogleモデルに対して最大242ポイントのリードを記録しています。数値が示す通り、「考えてから描く」というアプローチが品質評価においても有効であることが証明されています。

ChatGPT Images 2.0の主な新機能

2026年4月21日に正式リリースされたChatGPT Images 2.0(gpt-image-2)は、従来の拡散モデルをベースにしつつ、OpenAI独自の推論機能を統合した新世代の画像生成モデルです。単に画像を生成するだけでなく、生成前に計画を立て、必要に応じてWebから最新情報を取得し、品質を自己検証してから出力するという新しいアーキテクチャを採用しています。

発表内容として公表された主な機能は以下のとおりです。

- Thinking Mode:Web検索と推論を組み合わせた生成前プランニング機能。最新情報を取得してから正確な出力を行う

- 多言語テキスト対応:日本語・韓国語・中国語・ヒンディー語など非ラテン文字を約99%の精度で描画可能

- 複数画像一括生成:1回のプロンプトで最大8〜10枚を、キャラクター・スタイルの一貫性を保ちながら同時生成

- 2K解像度対応:高密度レイアウトや細部の精密な描画に対応。印刷用途にも使用可能な品質

- アスペクト比の自由度:3:1〜1:3の範囲で柔軟に指定可能。横長バナーから縦長SNS画像まで対応

これらの機能は「Instant Mode」と「Thinking Mode」の2層に分かれており、利用できるユーザー層が異なります。

Thinking Mode——考えてから描くとはどういうことか

Thinking Modeは、ChatGPT Images 2.0の最大の差別化要素です。従来の画像生成AIはプロンプトを受け取ると即座に生成処理を開始していましたが、Thinking Modeでは「何を描くべきか」「最新情報として何が正しいか」「生成した画像が指示と整合しているか」を事前に検証するステップを踏みます。

具体的には、地図や図解など最新情報が必要なビジュアルを生成する際、Thinking ModeはWeb検索を実行して情報を取得し、正確さを確認してから出力します。複数枚を一括生成する際には、キャラクターの外見・色・スタイルが各枚で一貫しているかを自己チェックするプロセスも組み込まれています。

OpenAIはこれを「視覚的思考パートナー(Visual Thought Partner)」と位置づけており、単なる生成ツールを超えた協働的な存在として設計されています。ニュースサイト向けインフォグラフィックや最新イベントのビジュアル素材のように、情報の鮮度が重要な用途においては、従来モデルとは別次元の精度を発揮することが期待されます。

日本語テキストと2K解像度が開く可能性

日本のクリエイターにとって特に重要な改善点が、日本語テキストの描画精度です。ChatGPT Images 2.0では、漢字・ひらがな・カタカナ・アルファベットが混在する高テキスト密度の画像でも文字崩れが大幅に抑えられています。電車の中吊り広告風ビジュアル、和風ポスター、書籍の表紙、情報量の多いインフォグラフィックといった用途で、実用に耐える品質が実現されました。

2K解像度(最大約2048×2048)への対応も商業利用の可能性を大きく広げます。従来のDALL-E 3が最大1024×1536に留まっていたのに対し、ChatGPT Images 2.0は印刷用途にも対応できる解像度を提供します。アスペクト比を3:1〜1:3の範囲で自由に指定できるため、横長のWebバナーから縦長のSNS投稿用画像まで、多様な用途に一モデルで対応できます。マンガやアニメといった日本固有のコンテンツ文化との親和性も、今後さらに深まることが期待されます。

DALL-E 3との比較と提供形態の変更

ChatGPT Images 2.0の登場とともに、OpenAIは大きな変更を既存ユーザーに通告しています。長年の主力モデルであったDALL-E 2とDALL-E 3は、2026年5月12日をもって廃止されます。以後はgpt-image-2が唯一の標準画像生成モデルとなり、ChatGPTとOpenAI APIの両方でデフォルトモデルとして提供されます。

APIを利用して画像生成機能を実装している開発者や企業にとって、5月12日という廃止日は対応スケジュール上の重要な節目です。以下の表に、DALL-E 3とChatGPT Images 2.0の主な仕様の比較をまとめます。

DALL-E 3 vs ChatGPT Images 2.0 主要仕様比較

| 項目 | DALL-E 3 | ChatGPT Images 2.0 |

|---|---|---|

| リリース時期 | 2023年10月 | 2026年4月21日 |

| 思考・推論機能 | なし | Thinking Modeあり |

| 日本語テキスト精度 | 低い(文字崩れ頻発) | 約99%(高精度) |

| 最大解像度 | 1024×1536 | 2K(約2048×2048) |

| 一括生成数 | 1枚 | 最大8〜10枚(一貫性あり) |

| Web検索連携 | なし | あり(Thinking Mode) |

| APIモデル名 | dall-e-3 | gpt-image-2 |

| 廃止予定 | 2026年5月12日 | 現行モデル |

DALL-E 3から何が根本的に変わったか

単純なスペック比較だけでなく、アーキテクチャの観点からも大きな変化があります。DALL-E 3はテキストをより忠実に反映するための「プロンプト理解の改善」に主眼を置いていましたが、ChatGPT Images 2.0は生成プロセスそのものに推論ループを組み込んでいます。

これは「プロンプトを読んで生成する」から「プロンプトを読んで計画し、確認してから生成する」への根本的な転換を意味します。従来モデルが1回の生成で完結していたのに対し、Thinking Modeでは生成前の調査・計画・検証というステップが加わります。複雑な指示やレイアウト指定の多い用途では、この差が品質に大きく影響します。

料金プランとAPIの注意点

利用形態は「Instant Mode」と「Thinking Mode」の2層構造です。Instant Modeは全ChatGPTユーザー(無料プラン含む)が利用でき、従来のDALL-E 3よりも高品質な画像を生成できます。Thinking Modeは、ChatGPT Plus(月額20ドル)・Pro(月額200ドル)・Business・Enterpriseの有料プラン加入者向けに限定されています。

API経由での利用は2026年5月初旬から順次開放される予定で、料金は出力品質と解像度に応じてトークン単価が変動する仕組みです。公開されている情報ではトークン単価$8〜$30(100万トークンあたり)とされており、高解像度・Thinking Modeでの出力になるほど費用が高くなります。DALL-E 3のAPI料金が画像1枚あたり$0.04(1024×1024 Standard)だったことを踏まえると、高品質出力を求めれば費用が上昇する可能性があり、コスト管理の観点から事前の試算が重要です。

業界と利用者への影響

ChatGPT Images 2.0の登場は、画像生成AIを業務活用してきたクリエイターや企業に対して複数の方向から影響を与えます。特に「テキスト入り画像の精度」と「複数画像の一貫性」という2つの長年の課題が解消されたことは、グラフィックデザイン・広告・出版・Webコンテンツ制作といった幅広い業界の実務を変える可能性を持っています。

これまで「テキスト部分だけ後から手動で入れる」というワークフローを採用していたデザイナーや制作チームは、このフローを見直す機会が訪れています。サムネイル制作、SNS投稿用バナー、Webメディアのビジュアル素材など、テキストと画像が組み合わさったコンテンツの制作において、AIの担える役割が大幅に拡大します。

影響が出る具体的な業務領域を整理すると、以下のようになります。

- 広告・マーケティング:日本語テキスト入りのバナーやポスターをAIで自動生成できるようになり、制作コストの削減が期待できる

- 出版・マンガ制作:キャラクター一貫性を保った複数コマの生成により、ストーリーボードやコンテ制作が効率化される

- ECサイト運営:商品画像の一括生成・サイズ別バリエーション制作が自動化できるようになる

- 開発者・API利用者:DALL-E 3のAPIからgpt-image-2への移行が2026年5月12日までに必要となり、早急な対応が求められる

- 教育・情報コンテンツ:Web検索連携による最新情報を反映したインフォグラフィックの自動生成が実用化できる

クリエイターと企業実務への具体的変化

テキスト描画精度の向上により、広告・マーケティング分野での活用可能性が大きく広がります。特に日本語テキストを大量に含む素材——サムネイル、広告バナー、電子書籍の表紙、SNS告知画像——の制作において、AIが担える工程が増えます。制作にかかる時間とコストの削減効果は、業種・業務量によっては相当の規模になり得ます。

一方、業務に組み込む際には品質確認プロセスを維持することも重要です。「約99%のテキスト精度」は高水準ですが、残り1%の誤りが商業ビジュアルでそのまま見落とされると問題になるリスクがあります。AIが生成したテキスト入り画像を最終確認なしで使用することは依然として慎重に判断すべきであり、人間によるチェック工程を完全に省くことは現時点では難しいでしょう。

日本市場における特有の注目ポイント

日本語テキストの描画精度が向上したことは、国内市場において特に意義深い変化です。これまで画像生成AIの商業利用において日本企業が感じていた「多言語ローカライズのハードル」が大幅に下がることが期待されます。大量の広告素材・教育コンテンツ・SNSビジュアルを制作する必要がある企業にとっては、実務上の時間とコストの削減効果が見込めます。

また、マンガやアニメといった日本のコンテンツ文化との親和性も注目されます。複数コマにわたるキャラクターの一貫性保持、日本語セリフの正確な描画、漫符や効果音といった日本マンガ特有の要素への対応が今後さらに深まれば、コンテンツ制作の現場に新たな可能性が開かれます。

今後の注目点と競合動向

ChatGPT Images 2.0の登場を受け、画像生成AI市場全体の競争構図は新たな局面に入っています。OpenAIの「思考機能統合」という戦略が奏功すれば、他社も同様のアプローチを採用することが予想されます。今後のAI画像生成市場を展望するにあたり、注目すべきポイントを整理します。

- 5月12日のDALL-E 2/3廃止後:gpt-image-2への移行状況とAPIの正式料金体系の公開

- Thinking ModeのAPI提供開始:2026年5月初旬に詳細が発表される見込み

- MidjourneyのV7以降の動向:テキスト描画と推論機能の有無が評価軸になる

- Google DeepMindの対抗策:Image Arena上位争いで242ポイント差をつけられた状況への反応

- オープンソース勢(Stable Diffusionなど)の戦略:クローズドモデルへの差別化を維持できるか

画像生成AIの競争が向かう先

2026年現在の画像生成AI市場のトレンドは、「美麗さの競争」から「使えるかどうかの競争」へと軸足が移っています。Midjourneyが長年築いてきた芸術的クオリティという優位性は依然として健在ですが、業務利用・商業利用においては「テキストが正確に入るか」「日本語に対応しているか」「複数枚を統一したスタイルで一括生成できるか」といった実用的な要件が評価軸になりつつあります。

ChatGPT Images 2.0が示した「推論と画像生成の統合」という方向性は、次世代画像生成AIの設計指針のひとつになる可能性があります。言語モデルが持つ推論能力を画像生成に活かすというアプローチは、OpenAI以外の各社も遅かれ早かれ採用するでしょう。そうなれば、「考えてから描く」ことが業界標準になる時代が訪れます。

「考える」AI画像がもたらす新しいワークフロー

これまでのAI画像生成は「生成→選択→修正」というサイクルが主流で、何度も試行錯誤しながら目的のビジュアルに近づけていくアプローチが一般的でした。Thinking Modeが浸透することで、このワークフローは「指示→計画→確認→生成」という形に変わる可能性があります。

また、Web検索との連携によって、最新の情報を反映したインフォグラフィックやニュース連動型ビジュアルコンテンツをリアルタイムに生成するという新しい活用シーンも生まれます。ニュースサイト・教育プラットフォーム・リサーチ用途において、「今この情報を視覚化する」という需要に応えられるツールへの進化が期待されます。

まとめ

OpenAIが2026年4月21日に発表した「ChatGPT Images 2.0」(gpt-image-2)は、画像生成前に推論・Web検索・自己検証を行う「Thinking Mode」、多言語テキストの約99%精度での描画、2K解像度での一括生成(最大8〜10枚)という3つの大きな進化を持っています。従来モデルであったDALL-E 2とDALL-E 3は2026年5月12日に廃止される予定で、画像生成のデフォルトモデルが世代交代します。

このニュースが重要な理由は、画像生成AIが「試して選ぶ道具」から「考えて作るパートナー」へと性格を変えようとしているからです。特に日本語テキストの描画精度向上は、国内の広告・出版・SNSクリエイターの業務フローに直接影響します。商業利用のハードルが下がることで、AI画像生成ツールの実務への浸透がさらに進むことが予想されます。

今後の注目点は大きく3つあります。第1に、5月12日のDALL-E廃止後にAPIを利用している開発者・企業がどれだけスムーズにgpt-image-2へ移行できるか。第2に、Thinking ModeのAPIとその料金体系がどのように公開されるか。第3に、競合のMidjourney・Google DeepMind・Stability AIがどのような対抗策を打ち出すかです。これらの動向を追うことで、2026年後半の画像生成AI市場の形が見えてくるでしょう。

「思考する画像AI」という概念は、数年前には想像もされていなかった方向性です。言語モデルの推論能力が画像生成に統合されたことで、AIツール全体の設計思想が変わりつつあると感じています。日本語コンテンツを扱う立場からは、長年の課題だったテキスト描画精度の向上は素直に歓迎できる進化です。ただし、Thinking Modeが有料プラン限定である点や、API料金が従来より高くなる可能性がある点はコスト管理として注意が必要です。次に見るべきは、5月12日のDALL-E廃止後の実際の移行状況と、gpt-image-2 APIの正式料金が公開された後の開発者・企業の反応です。

参考サイトまとめ

- Introducing ChatGPT Images 2.0 | OpenAI公式

https://openai.com/index/introducing-chatgpt-images-2-0/ - OpenAI、”視覚的思考パートナー”「ChatGPT Images 2.0」発表 | ITmedia AI+

https://www.itmedia.co.jp/aiplus/articles/2604/22/news057.html - “思考”する画像生成モデル「ChatGPT Images 2.0」 | Impress Watch

https://www.watch.impress.co.jp/docs/news/2103570.html - ChatGPT’s new Images 2.0 model is surprisingly good at generating text | TechCrunch

https://techcrunch.com/2026/04/21/chatgpts-new-images-2-0-model-is-surprisingly-good-at-generating-text/ - 米OpenAI、新画像生成モデル「ChatGPT Images 2.0」を発表 | SBビジネス+IT

https://www.sbbit.jp/article/cont1/184892

コメント