こんにちは!AIフル装備 powered by みらいラボのモモです。

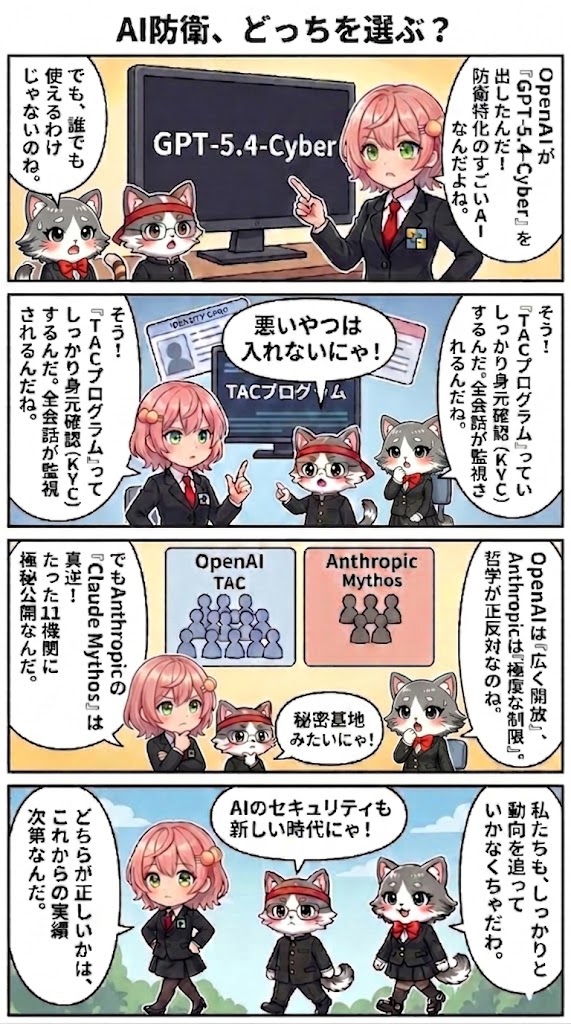

2026年4月14日、OpenAIはサイバーセキュリティ防衛に特化したAIモデル「GPT-5.4-Cyber」を正式発表しました。これはGPT-5.4をベースに防衛用途向けへファインチューニングしたもので、本人確認を通過したセキュリティ専門家を対象に段階的に提供されます。

この発表はAnthropicが「Claude Mythos」をわずか11機関に極秘公開してからほぼ同時期のことでした。Anthropicが危険性を理由に超限定公開を選んだのに対し、OpenAIは「本人確認と監視を徹底することで、広くアクセスを開放する方が有効な防衛策になる」という全く逆のアプローチを打ち出しました。

今回の記事では、GPT-5.4-Cyberが具体的に何をできるのか、どのようにアクセスを得るのか、そしてAnthropicとの哲学的な違いが何を意味するのかを詳しく整理します。単なるモデル公開のニュースではなく、AIがサイバーセキュリティの実務にどう組み込まれていくかを占う重要な動きです。

企業のセキュリティ担当者はもちろん、AIと社会インフラの関係に関心を持つすべての人にとって、このニュースは見逃せない展開です。「AIで守る」という時代が、実験段階を超えて本格的な実務フェーズに入りつつあります。

GPT-5.4-Cyberが登場した背景

2026年に入り、AIを活用したサイバー攻撃の精巧化が加速しています。脆弱性の自動発見、フィッシングメールの自動生成、マルウェアの自動改変など、攻撃側がAIを積極活用する場面が増え、防衛側にも同等レベルのAI支援が必要という声が業界全体で高まっていました。

こうした背景の中、OpenAIは2026年2月に「TAC(Trusted Access for Cyber)」プログラムを開始しました。これはサイバー防衛を担う個人や組織が、より高度なモデルへの特別アクセスを得られる認証制度です。TACの開始から約2か月でGPT-5.4-Cyberが追加され、プログラムが本格稼働した形です。

今回の拡張では、数千人の認証済み個人防衛者と数百チームが対象とされています。OpenAIは「できる限り広く使えるようにしながら不正利用を防ぐ」というバランスを目指しており、閉鎖的な利用制限よりも「誰が使うか」の透明性を重視する方針を明確にしました。

AIサイバー脅威の現状と業界の課題

AIによるサイバー攻撃は2025年後半から急速に精巧化しています。従来の人力による脆弱性調査では追いつけない速度で、AIが未知の脆弱性(ゼロデイ)を自動的に発見するケースが報告されています。Anthropicの発表によると、Claude Mythosは主要なOS・Webブラウザをまたいでゼロデイ脆弱性を数千件規模で自動検出したとされており、攻撃的AIの能力の高さが改めて業界の注目を集めました。

防衛側の現場では、既存の汎用AIに対する不満もありました。通常の会話AIはマルウェア解析や脆弱性の詳細な議論を自動拒否するよう設計されており、この「過剰拒否」が正規のセキュリティ研究者にとって業務の妨げとなっていたのです。OpenAIの既存サービス「Codex Security」がこれまでに3,000件以上の重大な脆弱性修正に貢献した実績があることも、専門家向けの高度なモデルへの需要を後押ししました。

TAC(信頼アクセスプログラム)の仕組みと申請方法

TACはKYC(顧客確認)型の身元確認を軸にした制度設計です。個人はchatgpt.com/cyberにアクセスして身元確認を行い、企業・チームはOpenAIの担当者を通じてチーム単位での申請ができます。アクセスレベルは複数のティアに分かれており、最上位ティアのみGPT-5.4-Cyberへのアクセスが付与されます。

認証後、全ての会話ログはOpenAIによって保持・監視される仕組みになっています。これは不正利用の抑止力として機能する設計ですが、同時にプライバシーへの懸念を生む要素でもあります。承認された用途は「セキュリティ教育」「防衛的プログラミング」「責任ある脆弱性調査」に限定されており、使用目的の範囲も厳格に設定されています。

GPT-5.4-Cyberの主要機能と技術的特長

GPT-5.4-Cyberの最大の特徴は、通常版では拒否するようなセキュリティ関連のクエリに対して、正当な防衛用途として回答できる設計になっている点です。ファインチューニングにより、脆弱性研究・エクスプロイト解析・マルウェア挙動の議論といった専門的な問いかけへの応答精度と深度が大幅に向上しています。

このモデルは個人のセキュリティ研究者から大規模なSOC(セキュリティオペレーションセンター)まで、幅広い実務フローへの統合を想定して設計されています。従来のAIにありがちだった「回答拒否による業務の中断」という摩擦を取り除き、防衛側の実務速度を高めることが主な目的とされています。

以下に、GPT-5.4-Cyberが対応する主な防衛ワークフローを整理します。

- バイナリリバースエンジニアリング: ソースコードなしでコンパイル済み実行ファイルを解析し、脆弱性・マルウェア挙動を特定

- 脆弱性の詳細評価: エクスプロイト手法や悪用シナリオを含めた深い分析が可能

- マルウェア挙動の解析: サンプルコードや実行トレースから不正動作のパターンを読み解く

- 大規模コードベースの脆弱性調査: 企業規模のソフトウェアをまたいだ包括的なリスク評価を支援

- セキュリティ教育への活用: 実践的な攻撃シナリオをもとにした研修コンテンツの作成補助

バイナリリバースエンジニアリングの実用的な意味

バイナリリバースエンジニアリングとは、コンパイル後の実行ファイル(ソースコードではなく完成品のプログラム)を解析し、そこに潜む脆弱性やマルウェア的な挙動を特定する作業です。従来、この作業は特定の専門知識を持つ熟練エンジニアが長時間かけて行う高コストな業務でした。

GPT-5.4-Cyberはコンパイル済みバイナリを入力として受け取り、マルウェアの可能性、埋め込まれた脆弱性、構造的な弱点などを分析した結果を出力します。ソースコードが非公開のサードパーティ製ソフトウェアや、取得した不審なファイルの安全性評価において、特に大きな効果が期待されています。

通常版GPT-5.4との違い——拒否境界の引き下げとその意味

通常版GPT-5.4は悪用リスクを避けるため、エクスプロイト手法の詳細、脆弱性の具体的な突き方、マルウェアの動作原理などについては応答を拒否する設計になっています。この設定は一般利用者の保護には有効ですが、合法的なセキュリティ業務においては業務効率の大きな障壁になっていました。

GPT-5.4-Cyberはこの拒否の閾値を防衛用途向けに大幅に引き下げており、認証済み防衛者には同じ質問に対してより詳細な回答を返します。ただし、全ての会話はOpenAIが保持・監視しており、不正利用が確認された場合はアクセスが取り消される仕組みです。「広いアクセス+厳格な監視」という組み合わせが、OpenAIが選んだ安全策の軸となっています。

AnthropicのMythosと徹底比較——正反対の公開哲学

GPT-5.4-CyberとAnthropicのClaude Mythosは、どちらも高度なAIサイバーセキュリティモデルですが、その公開方針は根本的に異なります。この違いを理解することで、今後のAIと安全の議論がどこへ向かうかが見えてきます。

Anthropicはclaude Mythosについて、「攻撃側の手に渡れば複数の脆弱性を連鎖させた複雑な攻撃が可能になる」と評価し、極めて慎重な姿勢を選択しました。英国のAI安全機関(AISI)の独立評価でも、Mythosは個別タスクではGPT-5.4とほぼ同等ながら、多段階の攻撃連鎖ではGPT-5.4を上回ると評価されており、その能力水準の高さが限定公開の根拠となっています。

下の表に、両モデルの主な違いをまとめます。

GPT-5.4-CyberとClaude Mythosの比較

| 項目 | GPT-5.4-Cyber(OpenAI) | Claude Mythos(Anthropic) |

|---|---|---|

| ベースモデル | GPT-5.4をファインチューニング | 新規設計の独立モデル |

| 公開範囲 | TAC認証者(数千人・数百チーム規模) | 厳選11機関のみ |

| 主な機能 | バイナリ解析・脆弱性評価・防衛ワークフロー支援 | ゼロデイ自動発見・多段階攻撃連鎖の模倣 |

| アクセス方法 | chatgpt.com/cyberで本人確認後、申請 | Anthropic直接招待のみ |

| 英国AISI評価 | 個別タスクでMythosと同等水準 | 多段階攻撃チェーンでGPT-5.4を超える |

| 安全策の軸 | 身元確認+全会話ログ保持・監視 | 超限定公開+機関レベルの監視 |

Mythosが極秘主義を採った理由

Anthropicが慎重な姿勢を取った直接の根拠は、Mythosが実際に発見した脆弱性の水準にあります。MythosはOpenBSDに27年間潜んでいたバグや、FreeBSDの17年物のリモートコード実行脆弱性など、単純なスキャンでは発見できないレベルの問題を自動的に突き止めたとされています。このような能力が悪意ある主体の手に渡れば、重要インフラへの攻撃や国家規模のサイバー工作に悪用されるリスクがあると判断されました。

Anthropicは「危険性の高いAIは可能な限り少数の信頼できる機関のみに提供する」という方針を安全策の基軸に据えています。この方針は安全面では保守的に最適化されていますが、防衛側の研究者や企業が最先端ツールにアクセスできないという課題も生んでいます。Mythosの極秘主義は、安全とアクセスのトレードオフを最も厳格に解釈した結果とも言えます。

OpenAIの「本人確認+監視」型アプローチとその課題

OpenAIが選んだのは「誰が使うかを特定できれば、広いアクセスを許容できる」という考え方です。KYC型の身元確認・段階的ティアのアクセス制限・全会話ログの保持を組み合わせることで、不正利用の抑止力を担保する設計になっています。この「認証+透明性」の組み合わせが、制限よりも実効性が高いとOpenAIは主張しています。

この方針に対してはセキュリティ研究者の間でも評価が分かれています。「防衛側が広くツールを持てることが重要」と評価する声がある一方、「認証プロセスを突破した攻撃者に悪用されるリスクが依然ある」と指摘する専門家もいます。どちらの方針が正しいかは、今後の実績によって判断される部分が大きいと言えます。

セキュリティ実務への影響と今後の注目点

GPT-5.4-Cyberの登場は、企業のセキュリティ部門に直接的な影響を与えます。これまでAIを使ったサイバー防衛ツールは実験段階のものが多く、現場での実用性に課題がありました。TACプログラムを通じて実際の業務フローに統合される段階が近づいており、セキュリティ担当者にとっての選択肢が増えることになります。

特に大きな変化が予想されるのはSOCにおける脅威分析の速度と精度です。従来、バイナリ解析やマルウェア調査は熟練エンジニアが数時間〜数日かけて行う作業でした。AIがこれを補助することで、インシデント対応の初動速度が大幅に改善する可能性があります。

一方で、GPT-5.4-Cyberを実際の業務に採用する際には注意すべき点があります。以下に懸念事項と導入上の注意点を整理します。

- TACの認証プロセスが突破された場合の悪用リスクは依然として残る

- 全会話ログをOpenAIが保持することで、機密性の高い業務への適用には慎重な判断が必要

- アクセスティアごとの許可範囲が現時点では不透明な部分があり、導入判断には詳細確認を要する

- 企業申請の審査速度と基準が今後の実用性を直接左右する重要な要素となる

- OpenAIとの契約・利用規約の細部が、どこまで業務に適用できるかに影響する

セキュリティ担当者が今すぐ注目すべき実務上の変化

SOCチームにとって最も即効性が高いのは、バイナリ解析の人員コストと時間の削減です。ソースコードが非公開のサードパーティ製ソフトウェアや、インシデント調査で入手した不審なファイルの安全性評価において、GPT-5.4-Cyberが大きな補助になり得ます。また、脆弱性研究の現場で日常的に発生していた「AIが拒否する」という摩擦が解消されることで、研究サイクル全体のスループットが向上します。

TACへの申請は個人であれば今すぐchatgpt.com/cyberから始められる状態です。企業や研究機関はOpenAIの担当者を通じたチーム申請が必要ですが、まず個人で認証を取得した後に組織的な活用を検討する流れが現実的です。今後、TACへの申請数が急増した場合にOpenAIがどの速度で審査を進めるかが、制度の実用性を左右します。

業界全体の方向性を左右する3つの焦点

今後の展開で注目すべき焦点が3つあります。第一は、TACプログラムの実際の運用実績と不正利用が報告されるかどうかです。OpenAIが主張するKYC型アプローチの有効性が、実績によって初めて検証される段階に入ります。第二は、AnthropicがMythosの提供範囲を今後広げるかどうかです。11機関限定という方針が維持されるのか、あるいはTACの成果次第で変わるのかは引き続き注視が必要です。

第三は、Google・MicrosoftなどのAI大手が同様のサイバー防衛専門プログラムをいつ、どのような形で開始するかです。OpenAIが先手を打ったことで、他社も専門家向けの特別アクセス制度の整備を急ぐと見られています。この競争が進む中で、セキュリティ専門家にとってのAIツールの選択肢は急速に広がるでしょう。

まとめ

2026年4月14日のGPT-5.4-Cyber発表は、AIとサイバーセキュリティが交わる地点における大きな転換点となりました。OpenAIはTACプログラムを通じて数千人規模の専門家にアクセスを開放する方針を打ち出し、Anthropicの慎重な限定公開路線と明確に異なる立場を示しました。バイナリリバースエンジニアリングをはじめとする高度な機能が認証済み防衛者に開放されることで、SOCの現場や脆弱性研究の速度・精度が変わる可能性があります。

このニュースが重要な理由は、「AIをどこまで開放するか」という問いに対して、業界を代表する2社が正反対の答えを示したからです。Anthropicの超限定公開とOpenAIの広い開放という対比は、AIの安全と有用性のバランスをめぐる根本的な哲学の違いを体現しています。この議論の行方は、今後のAI安全政策や規制の議論にも大きな影響を与えます。

今後の焦点は、TACの拡張ペースと不正利用の有無、AnthropicのMythosが今後どう展開されるか、そして他のAI大手が専門家向けプログラムをどう整備するかの3点です。特にTACが想定通りに機能するかどうかが、OpenAIの方針の正否を問う最大の試金石となります。

私モモとしては、今回のOpenAIの判断はリスクを引き受けた積極的なチャレンジだと受け止めています。「完璧に安全なAI公開の方法はない」という前提に立つなら、「誰が使うかを透明にする」というアプローチには一定の合理性があると感じます。ただし、それが機能するかどうかは今後数か月の実績が全てを語るでしょう。セキュリティ担当者の皆さんは、TACの申請方法と利用規約を今から確認しておくことをお勧めします。AIと防衛の関係はこれからますます重要になり、その動向を継続して追うことが実務上の判断に直結します。

参考サイトまとめ

- OpenAI公式ブログ「Trusted access for the next era of cyber defense」

https://openai.com/index/scaling-trusted-access-for-cyber-defense/ - The Hacker News「OpenAI Launches GPT-5.4-Cyber with Expanded Access for Security Teams」

https://thehackernews.com/2026/04/openai-launches-gpt-54-cyber-with.html - SiliconANGLE「OpenAI launches GPT-5.4-Cyber model for vetted security professionals」

https://siliconangle.com/2026/04/14/openai-launches-gpt-5-4-cyber-model-vetted-security-professionals/ - The Next Web「OpenAI releases GPT-5.4-Cyber for vetted security teams, scaling Trusted Access programme」

https://thenextweb.com/news/openai-gpt-5-4-cyber-trusted-access-defenders-mythos

コメント